点击右上角![]() 微信好友

微信好友

朋友圈

朋友圈

请使用浏览器分享功能进行分享

近日

DeepSeek低调上线了

新版V3模型DeepSeek-V3-0324

官方表示

如非复杂推理任务

建议使用新版V3模型

享受速度更加流畅

效果全面提升的对话体验

值得一提的是

业内的早期测试证实

该模型可以直接在消费级硬件上运行

2025年2月17日,用户在DeepSeek手机客户端上提问。

图源:新华社

初代DeepSeek-V3

发布于2024年12月26日

这款模型自上线后

便以高性价比火速“出圈”

根据官方技术论文披露

DeepSeek-V3模型的总训练成本

为557.6万美元

而GPT-4o等模型的训练成本

约为1亿美元

公开报道显示

此次新版V3模型

参数量为6850亿

借鉴了DeepSeek-R1模型

训练过程中所使用的强化学习技术

大幅提高了在推理类任务上的表现水平

在代码、数学、推理等

多个方面的能力

新版V3模型得到显著提升

其中代码能力追平

美国Anthropic公司的模型Claude 3.7

动图展示了一个由模型生成的演示多个小球在指定空间范围内运动的p5.js程序,包含若干可以调整重力、摩擦力等参数的滑动按钮,并以赛博朋克风格的HTML呈现。

图源:DeepSeek

《联合早报》报道称

让更多科技博主关注的是

V3-0324模型

可直接在消费级硬件上运行

不需要动辄千瓦级别功耗的数据中心

在社交平台X上

苹果机器学习工程师

Awni Hannun称

其已在512GB M3 Ultra的

Mac Studio上成功部署了

DeepSeek-V3-0324

并且实现了超过20 token/s的速度

2025年2月24日,湖北省襄阳市老年大学授课教师在电脑课上为学员讲解如何使用DeepSeek人工智能应用。

图源:新华社

Awni Hannun表示

这打破了业界

关于人工智能模型能力

与本地化运行或冲突的早前共识

也意味着数据中心

并不是大模型的必要搭配

中文IT技术社区CSDN

一篇文章认为

虽然说

售价74249元起的Mac Studio

并非普通大众级设备

但这一突破意味着

过去依赖多张 Nvidia GPU

高功耗数据中心运行的大模型

如今可以在功耗不到200瓦的

设备上运行

挑战了AI行业

对基础设施需求的传统认知

《联合早报》在文章中认为

这也意味着V3-0324模型的

部署和运营门槛已大大降低

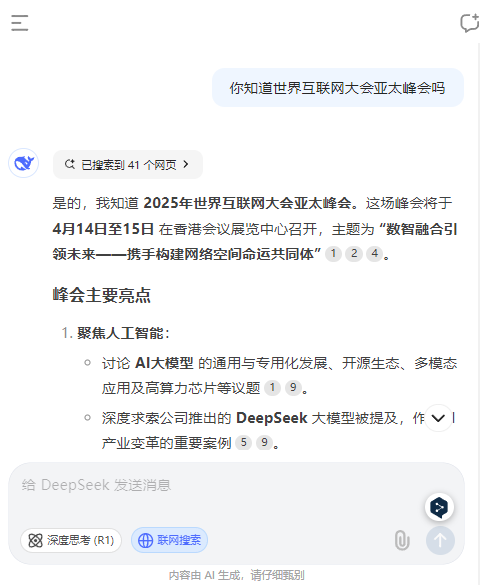

新版V3模型回复亚太峰会相关情况。

即将于4月14日至15日

在香港召开的

世界互联网大会亚太峰会

特别设置了“人工智能大模型”分论坛

围绕人工智能大模型的

通用与专用化发展等议题

邀请企业高管和专家学者

汇聚一堂,贡献创见

共议人工智能大模型

高水平开发与应用的

新理念、新策略

本次亚太峰会

还将面向公众开放部分门票

如有意报名

可通过大会官网在线购票

cn.wicinternet.org

↓↓↓

持电子门票

即可参加亚太峰会

世界互联网大会期待在香港

与你共话智能未来!

撰文:李飞、张祖有 排版:李汶键 统筹:李政葳

参考丨环球时报、每日经济新闻、澎湃新闻、观察者网、CSDN、DeepSeek公众号

光明网出品

更多内容欢迎扫码关注光明网数字化频道